Зомби-страницы: неофициальная метрика из западного SEO

Содержание

- Почему важно бороться с zombie pages

-

Типы зомби-страниц и их обнаружение

- Не проиндексированные URL

- Неадаптивные страницы "Non Responsive"

- Страницы с устаревшим или низкокачественным контентом

- Страницы, не оптимизированные для SEO

- Страницы-сироты

Тема, которую мы хотим рассмотреть, часто всплывает, при проблемах «почему трафик на сайте перестал расти, хотя с оптимизацией все нормально?» или «почему падают позиции, хотя уже исключены все очевидные причины?».

Зомби-страницы, из-за своей скрытности, представляют угрозу для крупных сайтов, способную повлиять на их видимость и репутацию в поисковых системах. Они не только снижают качество пользовательского опыта, но и могут значительно ухудшить показатели рейтинга и конверсии.

Термин пришел к нам из западного SEO, и ориентирован, разумеется, прежде всего на Google. С точки зрения Яндекса, есть своя терминология, и большая часть таких страниц, вероятно, будет признана малоценными. А вот Google с большой долей вероятности забросит их в долгий ящик «просканировано, не проиндексировано», если краулер вообще сможет до них добраться.

В этой статье мы расскажем, что такое зомби-страницы, почему они опасны для продвижения сайта, а также, как эффективно выявить и справиться с этой проблемой.

Почему важно бороться с zombie pages

- Это может улучшить UX. Устаревшие и заброшенные зомби-страницы могут привести к негативным последствиям для пользовательского опыта. Посетители, попавшие на такие страницы, могут испытать разочарование и недовольство, что отрицательно повлияет на показатели отказов и конверсии. Избавление от зомби-страниц нередко помогает создать более положительное впечатление у пользователей и повысить удовлетворенность визитеров сайта. Особенно это актуально для средних и крупных интернет-магазинов.

- Они влияют на общий рейтинг в поисковых системах. Поисковые алгоритмы оценивают качество и актуальность контента, а также сводную техническую составляющую сайта. Присутствие устаревших и бесполезных страниц снижает общую оценку сайта и влияет на его позиции в поисковых результатах. Избавление от зомби-страниц способствует повышению рейтинга и видимости вашего сайта в поисковых системах.

- Они тратят впустую краулинговый бюджет. Поисковые роботы тратят время на сканирование всех страниц вашего сайта. Это время не бесконечно: для каждого сайта у поисковиков выделен индивидуальный лимит. Зомби-страницы забирают ресурсы сканирования, которые могли бы быть направлены на более важные и актуальные ресурсы. Мы регулярно сталкиваемся с проблемой недостатка краулингового бюджета на сайтах с сотнями тысяч страниц. Избавление от зомби-пейдж позволяет оптимизировать распределение бюджета сканирования и сосредоточиться на контенте, который действительно важен.

Типы зомби-страниц и их обнаружение

Чтобы эффективно бороться с зомби-страницами, необходимо разработать их классификацию и методологию поиска.

Не проиндексированные URL

У больших сайтов в этот класс могут попасть и зомби, и нужные вам для продвижения страницы. Их необходимо отделять друг от друга. И хотя работа по их вычислению очень времязатратна - ее стоит проводить.

Индексация сайта, даже настроенная лично вами, может идти не по плану.

Ей могут мешать технические проблемы, например, долгое время загрузки или неверно настроенные скрипты).

Ошибки и конфликты в настройке индексации: никто не застрахован от них, особенно, когда с сайтом ведется работа на протяжение длительного периода).

Мнение поисковика достаточно часто отличается от мнения оптимизатора, и он индексирует страницы, закрытые в robots или неканонические, но при этом игнорирует приоритетные страницы из sitemap.

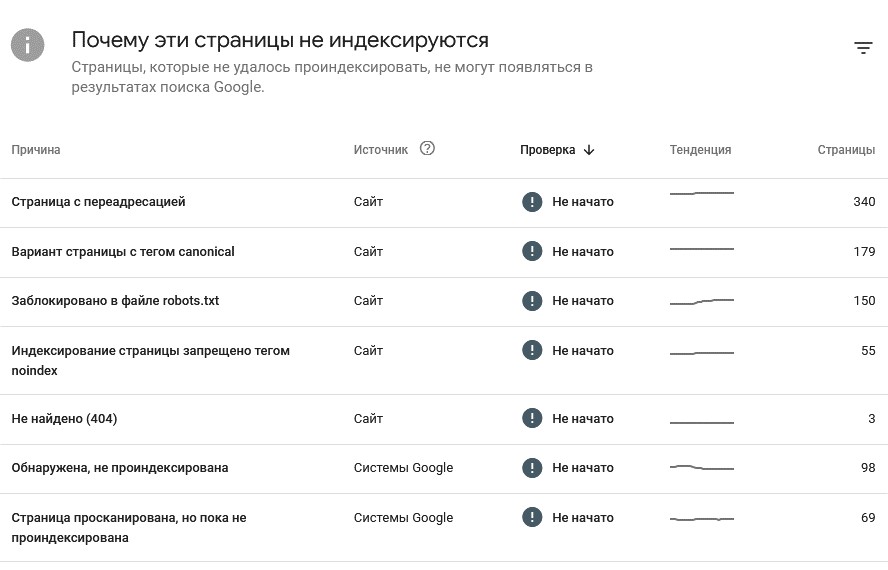

Выявить такие страницы поможет инструмент «Индексирование – Страницы» (раньше он назывался «Покрытие») в Google Search Console.

Там вы найдете блок «Почему эти страницы не индексируются», и сможете удобно выгрузить страницы с каждой причиной себе на Гугл Диск.

В Яндексе есть аналогичный инструмент «Исключенные страницы» в разделе «Индексирование – Страницы в поиске».

Неадаптивные страницы "Non Responsive"

Страницы, не оптимизированные для мобильных устройств, плохо ранжируются сами по себе, а также негативно влияют на пользовательский опыт и рейтинг в поисковых системах.

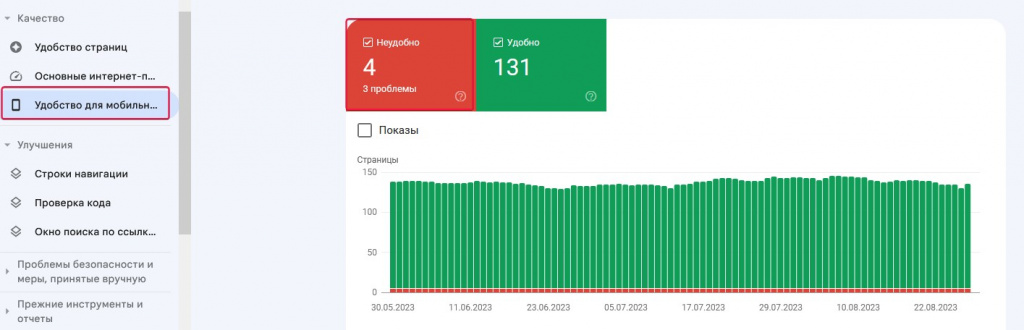

Массово выявить такие страницы можно в сторонних сервисах, или во все той же Гугл Сеч Консоли. Стоит обратить внимание, что Google анонсировал удаление отчета «Удобство для мобильных», так как он уже устарел.

Если вы планируете использовать этот отчет, обязательно нажмите на перепроверку страницы. В общем представлении — данные из кэша Google, которые могут быть устаревшими, или некорректно полученными из-за того, что страница медленно загружалась в момент сканирования ее роботом Google. При перепроверке мы в итоге часто получаем «мобилопригодную» страницу с точки зрения Google.

Однако ему на смену придет отчет «Удобство страниц» в той же сёрч-консоли, и оценка новой метрики INP там же, и в PageSpeed Insights c детализацией.

После того как проблемные страницы найдены, один из самых классических инструментов проверки: Google Mobile-Friendly Test. Однако, есть множество других комплексных платных и бесплатных инструментов (не реклама, просто одни из самых известных наборов эмуляторов: BrowserStack или MobileTest.me).

Страницы с устаревшим или низкокачественным контентом

«Просроченный» контент, или потерявший свою ценность по другой причине. А также изначально некачественно написанные тексты (например, пресловутые «seo-тексты по ключам» из прошлого :-), про написание которых всем давно пора забыть).

К этой же проблеме можно отнести дубли или очень похожий контент, методы поиска которого мы описывали тут.

Пакетно найти такие страницы не легко. Но план для работы с ними выработать можно:

1. Анализ систем сбора статистики. Изучите метрики, такие как время нахождения на странице, показатели отказов и взаимодействие с контентом. Если страницы имеют низкую среднюю продолжительность сеанса и высокий показатель отказов, это может указывать на проблемы с качеством контента.

Спарсите сайт целиком, и сравните с отчетом из Яндекс.Метрики (или GA) – какие из страниц, содержащих контент, совсем не посещаются. Какие из страниц имеют устаревшие даты публикации (если они используются на сайте) или старые даты, например, в заголовках. Посмотрите, есть ли спрос и посещаемость для таких страниц сегодня?

В качестве инструментов, вы можете выбрать выгрузки и ручной анализ из Яндекс.Метрики, Google Analytics и других систем сбора статистики. Но и можете частично автоматизировать эту работу, используя различные отчеты Screaming Frog SEO Spider:

- добавить столбец «Last Modified» в отчет, если этот заголовок настроен у вас на сайте;

- использовать фильтры по дате, для определения диапазона поиска страниц, которые не обновлялись в течение заданного периода;

- поиск по дате через Custom Extraction;

- интеграция с Google Analytics: вы сможете видеть данные о трафике и активности на страницах. Если страница имеет низкий трафик или активность в течение длительного времени, это может указывать на ее устаревший статус.

Проводите регулярные аудиты контента, оценивая его актуальность и ценность для пользователей. Идентифицируйте страницы с устаревшей или низкокачественной информацией.

2. Сравнение с конкурентами. Изучите контент на аналогичных страницах у конкурентов. Если вы обнаружите, что у вас есть страницы с менее полезным или актуальным контентом, который явно стоит обновить или расширить — это явный сигнал о необходимости внесения изменений.

Если вы берете материал для статьи у конкурентов, убедитесь, что ваша статья от них отличается. Она должна обладать добавочной полезностью к тому, что уже есть в интернете, а не быть просто рерайтом. Например, мы очень надеемся, что статья, которую вы сейчас читаете, даст вам что-то полезное, кроме того, что вы уже изучили про зомби-страницы, прежде чем попали к нам на сайт. Или, как минимум, поможет лучше структурировать информацию.

3. Обратная связь от пользователей. В виде отзывов, лайков, комментариев, репостов в соц сети, подписок на обновления, рейтингов или опросов на страницах сайта. Эти приемы нередки, но их используют далеко не все. И зря. Кроме того, что таким образом можно понравиться некоторым алгоритмам ранжирования (E.-E.-A.-T., коммерческие факторы и т.д.), вы получите некоторое базисное мнение вашей ЦА. Важно, после внедрения не забывать об анализе полученных данных.

Разумеется, этот метод плохо работает для сайтов с небольшой посещаемостью.

Страницы, не оптимизированные для SEO

Здесь все просто: отсутствие базовой оптимизации может превратить страницу в зомби. Метатеги, достаточный объем контента, микроразметка, приемлемая уникальность (особенно, относительно других страниц в рамках сайта), и другие факторы базовой технички, должны быть реализованы для всех страниц сайта, которые открыты для индексации.Страницы-сироты

Сироты - это страницы на сайте, которые находятся вне общей структуры иерархии и не связаны внутренними ссылками с другими URL. Они являются своего рода "одиночками", остающимися изолированными и неиндексируемыми для поисковых машин.

Сиротские страницы могут возникнуть по разным причинам, например, когда на сайте происходят изменения в структуре, или устаревает контент, который привязан к ним. Такие страницы часто не предоставляют ценной информации для пользователей и поисковых систем, что и делает их "зомби-страницами" с точки зрения SEO.

Выявить такие страницы несложно любым анализатором или seo-парсером (например, Screaming Frog Seo Spider, Site Analyzer и другие).

Кстати, если страница без внутренних ссылок на себя присутствует в sitemap.xml – это не бережет ее от возможности стать сиротой. Во-первых, поисковики могут посчитать ее малоценной; во-вторых, могут не обойти ее по карте сайта; в-третьих, такая страница будет иметь минимум ссылочного веса.

А вот внешние ссылки на такую страницу с большой долей вероятности выведут ее из сиротского статуса.

Профилактика и борьба с зомби-страницами (вместо заключения)

Если вы прочитали и поняли все, что написано выше, можете пропустить этот абзац :-). Он не несет в себе принципиально новой информации, и призван аккумулировать уже сказанное.

- Регулярный аудит контента. Обнаруживайте устаревшие страницы, слабый контент и страницы с низкой посещаемостью. Это позволит быстро выявлять потенциальные зомби-страницы и принимать меры.

- Обновление и переработка страниц. Зомби-страницы, которые содержат устаревший контент, можно вновь сделать живыми, обновив информацию и предоставив актуальную информацию для посетителей.

- Удаление бесполезных страниц. Если зомби-страницы не приносят ценности, и вы не видите возможности сделать так, чтобы приносили, - удалите их. Не стоит ограничиваться закрытием от индексации. Это позволит сконцентрироваться на более важных страницах и улучшить отношение поисковиков к вашему сайту.

- Установка редиректов. В случае удаления зомби-страницы, установите 301 редирект на страницу с близким по смыслу контентом. Это поможет сохранить поисковые позиции, если они были, и перенаправить трафик.

- SEO чек-листы, мониторинг и анализ. Регулярно следите за показателями ваших страниц, такими как базовая оптимизация, видимость, позиции в поисковых системах и оценки качества. Это поможет выявить проблемные страницы и предотвратить их превращение в зомби-страницы.

- Анализ трендов и обратной связи от посетителей сайта. Это поможет определить, какие страницы становятся менее актуальными, и предпринять меры по их обновлению.

- Оптимизация для мобильных устройств. Это поможет избежать появления "non responsive" zombie page, и положительно отразится как на юзабилити (а значит, и конверсии) сайта, так и на позициях в поисковиках.

- Уделяйте время каждой новой создаваемой странице. Применяйте актуальные практики SEO при создании новых страниц и обновлении существующих. Это позволит избежать появления «зомби- плохой-оптимизации». Даже если вы наполняете крупный сайт с тысячами товаров – это можно выполнить. Хорошо продумайте состав и шаблоны будущих страниц, настройте маски метатегов и заголовков, оптимизируйте изображения, используйте микроразметку. Несмотря на то, что эти советы от сеошников уже порядком надоели, на огромном количестве сайтов они не реализованы!

- Внутренняя перелинковка. Убедитесь, что ваши страницы связаны внутренними ссылками. Что на сайте понятная, логичная и удобная навигация. Это поможет обеспечить сквозной поток трафика на важные страницы.

Конечно, процесс обнаружения и борьбы с зомби-страницами может показаться сложным и трудоемким заданием. Если вам сложно разобраться в деталях, у вас нет времени или желания заниматься этим самостоятельно, обратитесь к SEO-экспертам нашей компании. Мы готовы взяться за этот сложный процесс и обеспечить вашему сайту эффективное и успешное развитие.

Мы предлагаем как циклическую услугу продвижения вашего сайта, так и отдельные работы SEO в разовом формате, без регулярной оплаты!